自律的なAIエージェント、LAWS、ADMの概要と自律性【RMFOCUS 第93号】

RM NAVI会員(登録無料)のみ全文閲覧できます

RM NAVI会員(登録無料)のみ全文閲覧できます

[このレポートを書いたコンサルタント]

- 会社名

- MS&ADインターリスク総研株式会社

- 所属名

- 基礎研究部 受託調査グループ

- 執筆者名

- マネジャー上席研究員 土居 英一 Eiichi Doi

2025.4.2

- 自律的なAIエージェントは、環境を認識し、目標達成のために意思決定・行動するシステムであり、2025年以降本格普及が見込まれる。市場規模も急拡大し、2030年代には数十兆円規模に達すると予測されている。

- LAWS(自律型致死兵器システム)は、人間の介入なしに攻撃を実行する兵器であり、倫理的・法的問題が議論されている。国際的な規制の検討が進められているものの、民主主義国家と専制主義国家間の意見の相違などが課題となっている。

- 技術進化のスピードが加速する中、企業はAIエージェントの導入を単なる業務効率化にとどめず、経営戦略の中核に据えることが重要である。自律的AIのリスク管理を考慮しつつ、積極的な情報収集などの検討を進めることが必要となる。

1. 急速に注目が高まる自律的に意思決定するAIシステム

自律的なAIエージェント、自律型致死兵器システム(LAWS:Lethal Autonomous Weapon Systems)、自律的意思決定(ADM:Autonomous Decision-Making)は、人工知能の進化と共に注目を集めているAIシステムの種類である。自律的に意思決定するこれらのシステムは、2025年に注目を集めると考えられる。

特に、2024年末から急速に世間の関心が高まっているのが自律的なAIエージェントであり、2025年から本格的に普及すると見込まれている。一般的に、自律的なAIエージェントは、これまでのAIエージェントから進化し、ユーザーの指示を待つだけでなく、目標達成に向かい、自ら環境を認識し、分析・判断し、意思決定し、行動するシステムを指す。

たとえば、OpenAIが開発中(執筆時点現在の情報に基づく、以下同様)の「Operator」は、ユーザーの指示に基づき、コンピューターを自律的に操作してタスクを実行する。旅行の予約やプログラミングコードの作成など、複数のステップを要するタスクを最小限のユーザーの介入で、適切に実行する能力を持っているといわれている。

LAWS(自律型致死兵器システム)は、AIを搭載し、人間の介入なしに標的を識別・選択し、攻撃を実行する兵器システムである。ドローンやロボットの形態をとり、センサーやAIを用いて、自律的に作戦行動を行う。この技術は戦場での兵士の死傷リスクを低減できることなどから期待する声も多いものの、AIが人間の生死の判断を下す倫理的問題や、誤作動による無差別攻撃・ターゲット誤認攻撃のリスク、責任の所在が不明など、まさにいま国際的な議論が進みつつある分野である。

ADMという言葉は認知度の低い言葉であるが、現状理解に有益と考え紹介する。ADMは、AIシステムが人間の介入なしに独立して選択したり行動したりする能力を指す。データ収集、処理、意思決定、実行という一連のプロセスを含む。たとえば、自動運転車はセンサーやカメラを用いて周囲の情報を収集し、リアルタイムでデータを処理して最適な運転操作を判断し、それを実行する。ADMは、これまで「AutomatedDecision-Making(自動意思決定)」として使われることが多かったものの、近年では「Autonomous Decision-Making(自律的意思決定)」として使われるケースが増えている。これは、AIシステムが単なる自動化されたプロセスを超え、自律的に判断し行動する能力を持つようになったことを反映している。

本稿では、自律的なAIエージェントと、LAWSの概要を説明する。さらにADMを加え、それぞれの関係性につき、「自律性」に焦点を当てて考察する。

2. 自律的なAIエージェントの発展と課題

(1) AIエージェントの市場規模予測

AIエージェント市場は2030年代に数十兆円規模に達すると予測されている。2024年の市場規模は約50億ドルと推定され、2030年には約500億ドル、2032年には約1,000億ドルへと加速度的に拡大すると予測されている。

(2) AIエージェントの概念と進化

AIエージェントとは、特定の目的の達成に向け、外部環境との相互作用を通じてタスクを実行する人工知能システムである。AIエージェント自体はこれまでも存在している。従来のAIエージェントは、特定の入力に対し決まった応答を返すルールベースのシステムが主流であったが、いま注目されているのは、生成AIとの連携などにより、完全自律型に近づくことである。AIエージェントは次のように分類できる。

①反応型AI(Reactive AI)

過去の経験や内部モデルを持たず、現在の状況に基づいて即座に判断を行う。たとえば、チェスAIのように、現在の盤面を評価し最適な手を選択するようなシステムも、このカテゴリーに該当する。

②目標指向型AI(Goal-Oriented AI)

事前に与えられた目標に向かって行動し、計画を立てながら最適解を探索する。(例:自動運転車のナビゲーションAI)

③完全自律型AI(Fully Autonomous AI)

理論上、人間の介入なしに意思決定を行い、環境の変化に適応しながらタスクを遂行する。現在、まだ具体的な実現例は存在していない。

(3) AIエージェントのレベル

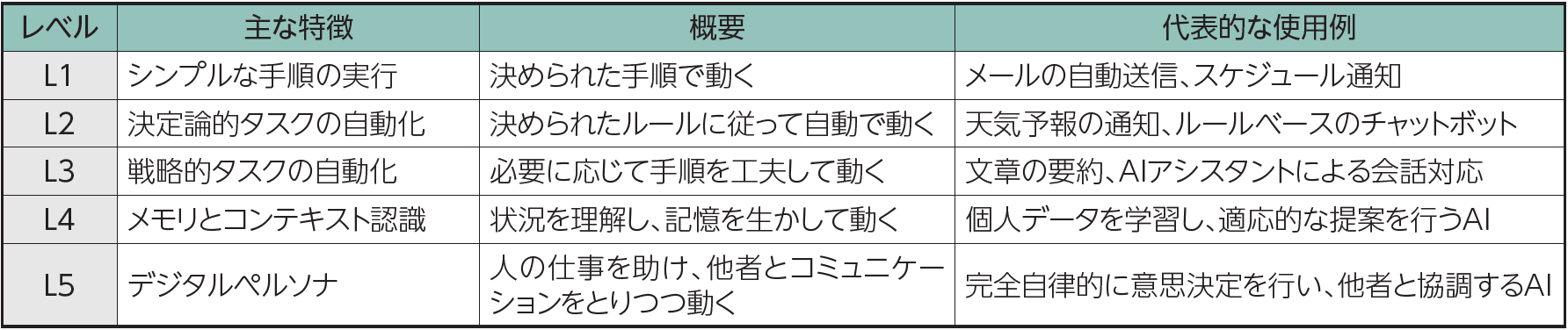

AIエージェントは、その自律性の程度に応じて分類できる。表1に、AIエージェントの進化段階を示す。

(4) RPAと自律的なAIエージェントの違い

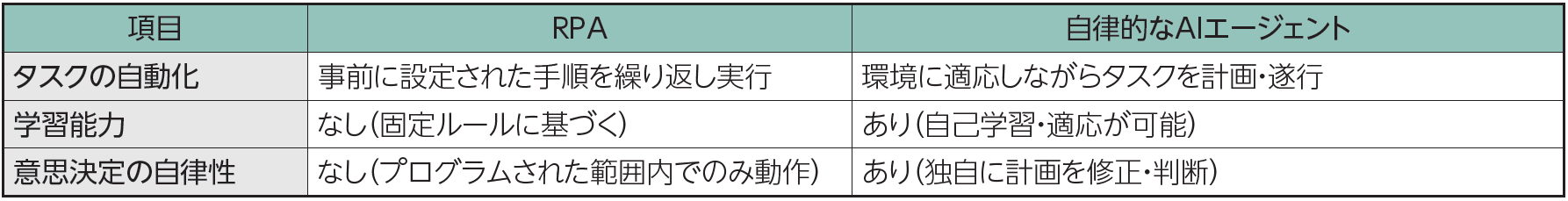

RPA(Robotic Process Automation)と自律的なAIエージェントは混同されがちであるが、別のものと考えられる(表2)。

RPAは業務の効率化には優れるが、環境変化への適応力を欠き、固定ルール内でのみ機能する。一方、自律的なAIエージェントは自律的に学習し、予測・適応しながらタスクを実行する点が異なる。

【表1】AIエージェントのレベルと特徴

【表2】RPAと自律的なAIエージェントとの違い

(5) 完全自律型AIエージェント

完全自律型AIエージェントは、人間の指示を最小限に抑えながら、複雑な意思決定を行い、環境と適応しながら相互作用できるようになるであろう。その特徴として以下の点が挙げられる。

①タスクの自動計画と実行

目標を理解し、サブタスクに分解して実行する。また、予期しない状況に対応し、計画を修正できる。

②外部リソースの活用

インターネット検索やAPI連携を通じて、必要な情報を取得できる。他のAIエージェントと協調しながら業務を遂行することもできる。

③継続的な学習と適応

過去の経験を蓄積し、次回のタスクに生かせる。また、強化学習やフィードバックループを活用して性能を向上していくこともできる。

(6) 課題

①人間の意図とAIの意図の不一致

AIエージェントは、目的を達成するために最適な行動を選択する。結果として人間の意図とずれを生じることもありえる。たとえば、マーケティングAIが「売り上げ最大化」を目的とした際、倫理的に問題のある広告手法を選択する可能性がある。このような事態を防ぐため、価値観の整合性(Value Alignment)問題の研究などを進めるべきである。

②AIエージェントの誤作動と予測不可能性

完全自律型AIは、複雑な意思決定をするため、どのように結論に至ったかのプロセスを人間が理解することが難しくなる。特に、ブラックボックス問題(AIの判断プロセスが不透明)は、安全性や信頼性の観点の課題となる。これに対し、説明可能AI(Explainable AI:XAI)の検討が進められている。・・・

ここまでお読みいただきありがとうございます。

以下のボタンをクリックしていただくとPDFにて全文をお読みいただけます(無料の会員登録が必要です)。

会員登録してPDFで全て読む

ご登録済みの方は

58763文字